应用介绍

使用指南

平台目前提供 个人实例 和 公共集群作业 的 tensorflow 使用方式,两种方式的区别是:

- 个人实例:可以直接在jupyterlab页面交互使用tensorflow

- 作业:可以提交tensorflow作业,在后台长时间训练

一、使用个人实例运行tensorflow

1. 通过 “申请资源” 中,找到 tensorflow 应用模板,创建个人实例

2. 启动实例,打开用户界面后,可以看jupyterlab已经提供了tensorflow-2.8的虚拟环境

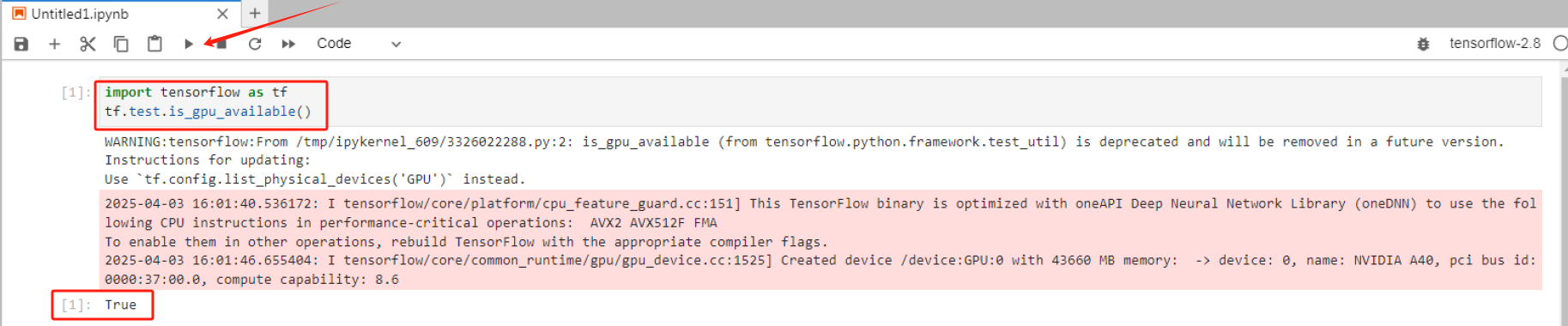

3. 打开 tensorflow-2.8的虚拟环境,输入如下内容,并点击上面的运行按钮:

import tensorflow as tf

tf.test.is_gpu_available()

- 代码运行后,获得如图所示的输出,即表示成功调用tensorflow环境,可以继续调试其它代码

二、使用公共集群提交tensorflow作业

平台公共集群提供了可以直接使用的singurlarity镜像,由于tensorflow新版本稳定性较差,所以目前只提供了2.12版本。

用户如果没有平台作业提交的经验,可以先查看 帮助中心 - 作业系统部分,了解作业提交的基本概念和操作方法。

1. 准备 tensorflow 官方提供的测试demo,内容如下:

import tensorflow as tf

mnist = tf.keras.datasets.mnist

(x_train, y_train),(x_test, y_test) = mnist.load_data()

x_train, x_test = x_train / 255.0, x_test / 255.0

model = tf.keras.models.Sequential([

tf.keras.layers.Flatten(input_shape=(28, 28)),

tf.keras.layers.Dense(128, activation='relu'),

tf.keras.layers.Dropout(0.2),

tf.keras.layers.Dense(10, activation='softmax')

])

model.compile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

model.fit(x_train, y_train, epochs=5)

model.evaluate(x_test, y_test)

- 这段代码实现了一个基于TensorFlow的手写数字识别模型(MNIST分类任务),这个模型展示了深度学习处理图像分类任务的基本流程,可作为入门经典案例理解神经网络的核心要素。

- 在用户的个人目录下新建名称为 tensorflow-demo.py 的脚本文件,并将以上内容粘贴进脚本中

2. 准备作业提交脚本,内容如下:

#!/bin/bash

#SBATCH --job-name=tensorflow-demo

#SBATCH --nodes=1

#SBATCH --ntasks-per-node=10

#SBATCH --output=%j.out

#SBATCH --error=%j.err

#SBATCH --partition=gpu

#SBATCH --gres=gpu:1

export PATH=/usr/local/nvidia/bin:$PATH

export NVIDIA_PATH=/usr/local/nvidia

export LD_LIBRARY_PATH=/usr/local/nvidia/lib:$LD_LIBRARY_PATH

/opt/app/singularity/bin/singularity run --nv -B /usr/local/nvidia:/usr/local/nvidia /opt/app/sif/tensorflow_2.12.sif python tensorflow-demo.py

- 脚本中,指定gpu分区,申请了1个节点、10个CPU核心、1张GPU卡

- 在用户的个人目录下新建名称为 tensorflow-test.sh 的脚本文件,并将以上内容粘贴进脚本中

3. 使用sbatch tensorflow-test.sh 命令提交作业

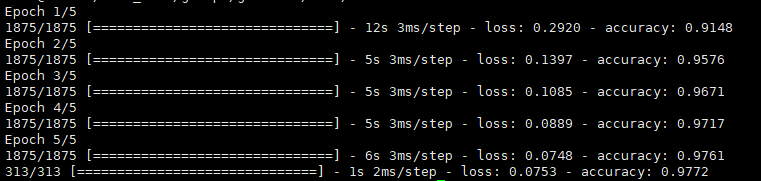

作业提交后,查看 %j.out 、%j.err 脚本,看到如下内容即表示成功使用tensorflow进行训练

参考链接:

https://colab.research.google.com/github/tensorflow/docs/blob/master/site/en/tutorials/quickstart/beginner.ipynb?hl=zh-cn